Linear Regression

标签

ML

AI

字数

412 字

阅读时间

2 分钟

本节来介绍基于最小二乘法的线性回归。

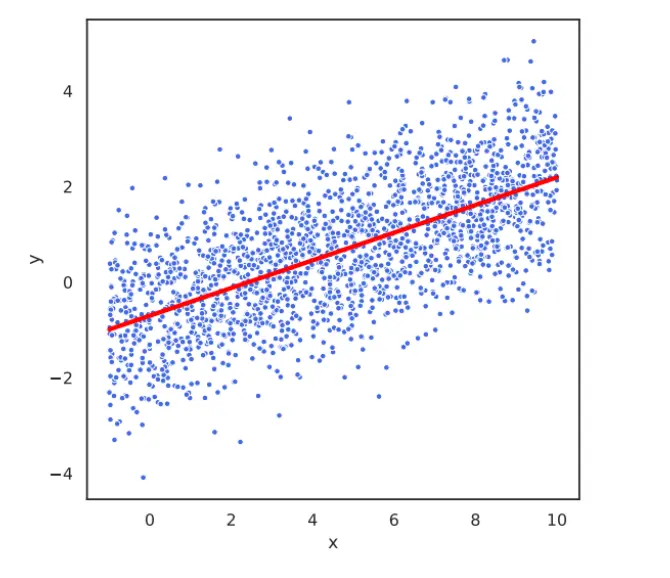

情景描述

真实的x,y存在这样的关系:

其中,f(x,w) 是基准的线性,epsilon是固有噪音,这玩意没法确定。有了这个噪音,你的真实标签看起来就是这样的:

度为1的OLS

degree为1,说明w只有一个,外带一个截距。所以我们假设目标函数是这样的:

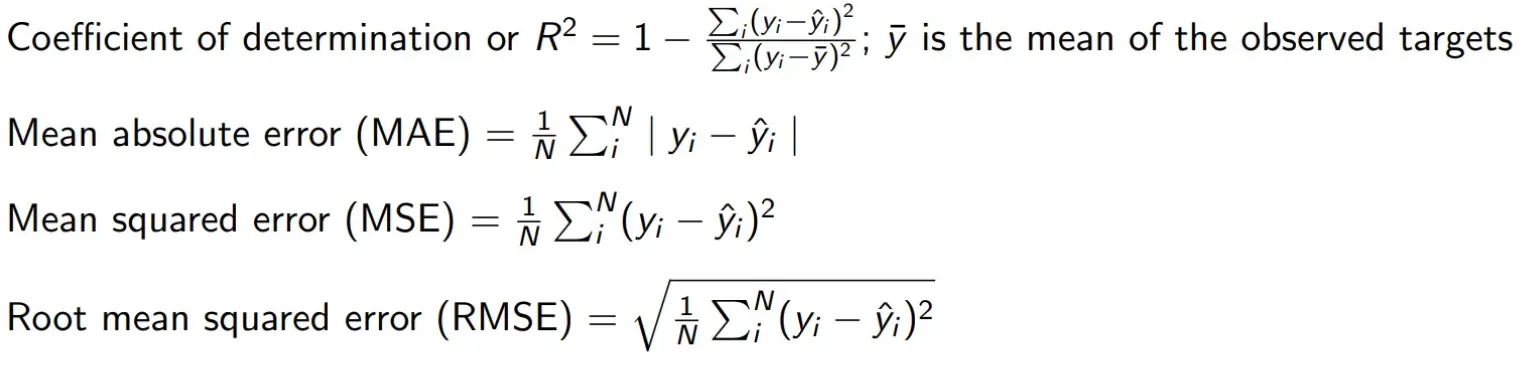

那么损失如果用MSE的话,就是这样的:

为了最小化损失,所以求导:

求导得到的结果如下:

写成矩阵形式就是这样:

解就是这样:

任意degree OLS

定义目标函数为这样:

其中phi是非线性变化,phi0(xi) = 1。 求导为0得到结果:

如果我们记 design matrix

那么上面的带求和的式子就可以写为:

然而,由于

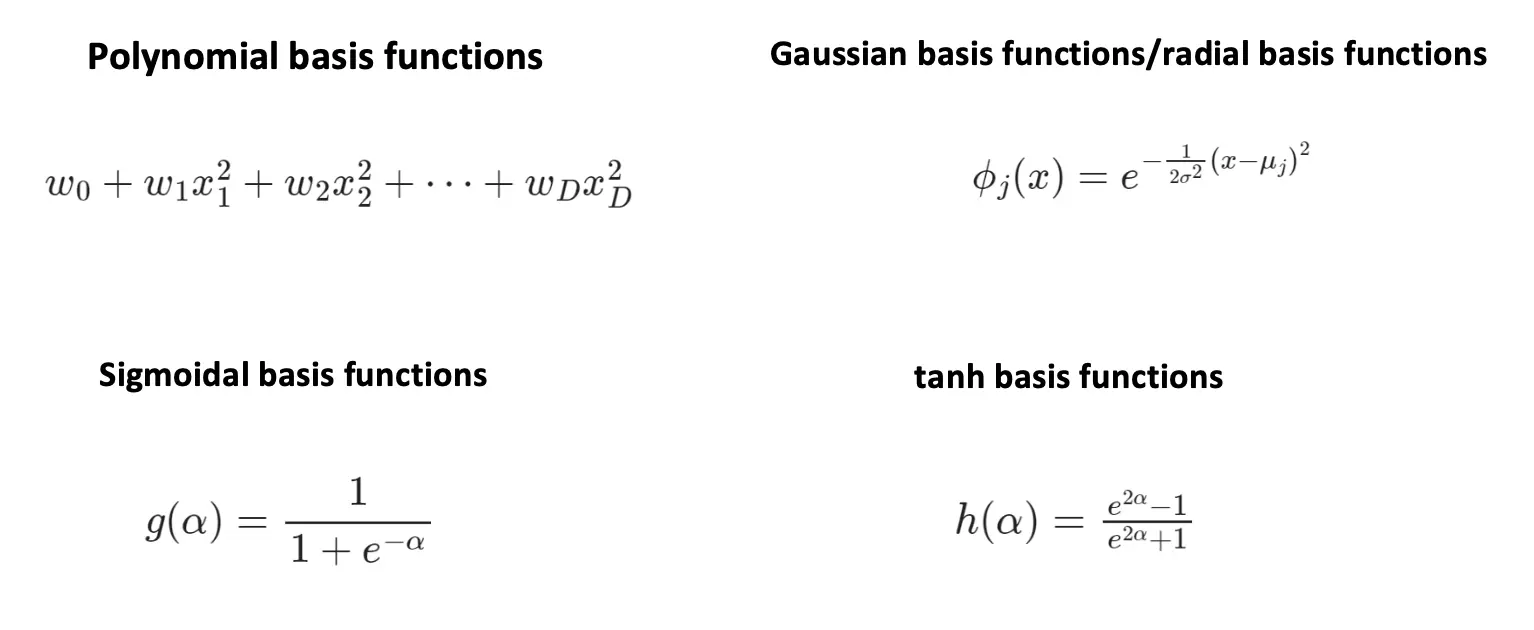

非线性嵌入

这里介绍四种非线性嵌入:

Larry Shi

Larry Shi